行业新闻与博客

安全研究人员就人工智能生成代码中的漏洞发出警报

佐治亚理工学院的研究人员警告称,像 Anthropic 的 Claude Code 这样的 Vibe 编码工具正在给软件带来大量新的漏洞。

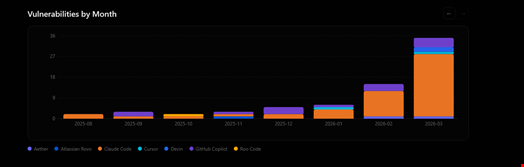

2026年3月,至少有 35 个新的常见漏洞和披露(CVE)条目被披露,这些漏洞和披露是人工智能生成代码的直接结果。这一数字高于 1月份的 6 个和 2月份的 15 个。

这些漏洞正在被追踪,这是“ Vibe 安全雷达”项目的一部分,该项目由佐治亚理工学院网络安全与隐私学院下属的系统软件与安全实验室 (SSLab) 于 2025 年 5 月启动。

佐治亚理工学院如何追踪人工智能编码工具引入的缺陷

Vibe 安全雷达旨在追踪由 AI 编码工具直接引入的漏洞,这些漏洞已发布到公共安全公告中,例如 CVE.org 、美国国家漏洞数据库 (NVD) 、 GitHub 安全公告数据库 (GHSA) 、开源漏洞 (OSV) 、 RustSec 等。

Vibe Security Radar 创始人赵汉青在接受Infosecurity 采访时表示:“大家都说AI 代码不安全,但实际上没有人追踪它。我们想要的是真实的数据,而不是基准测试或假设,而是影响真实用户的真实漏洞。”

他强调,现在越来越多的人开始对整个项目进行氛围编码, “直接投入生产”,因此这种跟踪工作至关重要。

“实际上,即使有团队进行代码审查,当一半的代码库都是机器生成的时,也不可能发现所有问题,”他补充道。

涵盖 50 个 Vibe 编码工具,追踪 74 个漏洞

赵声称他的团队追踪了大约 50 个 AI 辅助编码工具,包括 Claude Code 、 GitHub Copilot 、 Cursor 、 Devin 、 Windsurf 、 Aider 、 Amazon Q 和 Google Jules 。

为了开发 Vibe 安全雷达仪表板,研究人员首先从公共漏洞数据库中提取数据,找到修复每个漏洞的提交,然后回溯以找出最初引入该漏洞的人。

赵告诉 Infosecurity:“如果该提交带有 AI 工具的签名,例如共同作者标签或机器人电子邮件,我们会将其标记出来。”

最后,该团队使用人工智能代理来“了解每个漏洞的根本原因,并确定人工智能生成的代码是否导致了该漏洞”。

他说:“特工们可以访问实际的 Git 存储库和提交历史记录,因此他们可以进行真正的调查,而不仅仅是模式匹配。”

在已确认的 74 起直接由 AI 编码工具引起的 CVE 漏洞中,Claude Code 出现的频率最高,但赵指出,这主要是因为 Anthropic 的工具“总会留下痕迹”。

他补充说:“像 Copilot 这样的工具的内联建议功能则完全不留痕迹,因此更难被发现。”

Claud Code 引入的缺陷如此普遍,也可能是因为该工具在软件开发社区中被广泛使用。

开源项目隐藏了大多数与人工智能相关的缺陷

然而,赵承认,由于使用 AI 编码工具而产生的 CVE 实际数量“几乎肯定”比 Vibe Security Radar 仪表板上显示的数量要高。

“这些只是会留下元数据痕迹的案例。根据我们在类似项目中观察到的情况,我们估计实际案例数量是目前检测到的五到十倍,在整个开源生态系统中大约有 400 到 700 例,”他说。

“以 OpenClaw 为例。它有超过 300 条安全公告,而且我们知道该项目严重依赖 vibe 编码。但大部分 AI 工具的痕迹已被开发者抹去,因此我们只能确认大约 20 个具有明确 AI 信号的案例。”

此外,还有很多漏洞从未获得公开标识符(例如 CVE 或 GHSA 编号),因此无法轻易追踪。

此外,赵确信,人工智能编码工具带来的漏洞数量“只会不断增加”。

“上个月,仅 Claude Code 一人就在 GitHub 上贡献了超过 4% 的公开代码,而且这个数字还在不断攀升。更多的 AI 代码意味着更多的 AI 引入的漏洞,”他说道。

Vibe 安全雷达是一个长期项目,他和他的团队将不断改进它。

“目前,我们依赖于诸如合作者标签和机器人邮箱之类的元数据,但人们会忽略这些信息。下一步是着眼于更宏观的层面:整个项目、提交模式和整体编码风格。人工智能编写的代码具有可识别的特征。我们正在开发无需任何显式元数据即可识别这些信号的模型,”他总结道。

图片来源:aileenchik / Shutterstock.com

最近新闻

2026年04月15日

2026年04月15日

2026年04月15日

2026年04月15日

2026年04月10日

2026年04月10日

2026年04月10日

2026年03月31日

需要帮助吗?联系我们的支持团队 在线客服